Margarete Ertl, Allemagne

Margarete Ertl, Allemagne

chef de chœur et pédagogue

Cet article est basé sur une conférence qui aurait dû avoir lieu dans le cadre du Symposium Mondial sur la Musique Chorale à l’été 2020 à Auckland, en Nouvelle Zélande. Le Symposium ayant dû être annulé, l’ICB vous offre ici un apercu du sujet à travers une version écrite.

Découvrez le monde fascinant des neurosciences et de la symphonie des neurones. Dès le stade prénatal, les premières perceptions d’”éléments musicaux” stimulent le cerveau humain. Avec chaque perception musicale, lors de chaque répétition ou concert, les chefs, compositeurs ou chanteurs travaillent au développement de leur réseau neuronal personnel.

Lorsqu’un être humain chante, son cerveau traite davantage d’informations que la simple syntaxe verbale et musicale. Il contrôle les fonctions corporelles involontaires, le mouvement de l’appareil vocal, des yeux, des membres ou de la posture. Il corrige et ajuste les muscles via des signaux sensoriels, visuels ou auditifs. Parallèlement, il mémorise, pense à l’avance, calcule, trouve des solutions, reste concentré et traite les informations visuelles venues de la partition ou du chef de chœur. Il contrôle en permance la respiration et la voix afin de régler la hauteur, le timbre, la pulsation, le tempo, le rythme, les propriétés résonatrices des voyelles et des consonnes dans différentes langues. Le cerveau apprend et se souvient des commentaires et requêtes liées à l’expression musicale. Le chanteur interagit avec d’autres musiciens, non seulement musicalement mais aussi émotionnellement et socialement, se mélangeant avec les autres voix et gardant en tête les exigences acoustiques. L’oreille est en permanence en alerte, concentrée sur la propre production vocale du chanteur et sur tous les autres sons environnants, qu’elle analyse en les hiérarchisant par priorité. En plus de tout cela, des processus chimiques guident simultanément les sensations et émotions personnelles. Afin d’atteindre cette performance, un réseau neuronal hautement complexe est nécessaire.

Cet article résume l’état actuel de la recherche, en mettant l’accent sur les résultats concernant le domaine du chant sous forme d’un chatoyant voyage dans la magie de la musique: Tout d’abord, vous aurez un apercu du cerveau humain et de son système nerveux. Ensuite il s’agira d’aborder les techniques d’imagerie du système neuronal, qui présentent les activités des différentes structures du cerveau humain lors des complexes processus vocaux. Enfin, le chapitre final se tourne vers l’anatomie du cerveau et ouvre une perspective sur de fascinants et récents domaines de recherche. Y seront présentés différents processus neuronaux et interactifs de différentes régions du cerveau qui sont, selon les résultats de chercheurs renommés, engendrés pendant l’activité vocale.

La recherche neuroscientifique décode pas à pas les processus neuronaux grâce à des diagnostics de pointe. Ceci révèle des détails fascinant sur la symphonie neuronale qui résonne dans notre cerveau lorsque nous chantons, imaginons et écoutons de la musique. Pendant longtemps, la recherche neurologique s’est concentrée sur les instrumentistes. Mais ces dernières années, des chercheurs ont découvert que la voix chantée, dans sa grande complexité, constituait un objet de recherche très intéressant.

Environ 80 milliards de neurones sont constamment en communication entre eux. Des impulsions électriques et des processus chimiques interagissent avec la matière grise (les neurones et les cellules gliales) et la matière blanche (les axiomes recouverts de myéline). La densité de la structure cérébrale augmente avec les stimuli éléctriques ou chimiques ou dégénère lorsqu’elle n’est pas utilisée. Les impulsions éléctriques peuvent être rendus audibles au moyen de la technique dite du “Patch-clamp”. Ainsi, les scientifiques peuvent collecter des données et écouter la symphonie des neurones en direct. Notre cerveau ne traite pas seulement des informations, il est en quelque sorte de la musique lui-même, ou bien il “chante” nos pensées pour les faire exister.

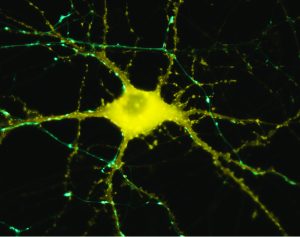

Les neurones régulent tout, du système nerveux autonome jusqu’à la cognition, et guident un grand nombre de réseaux couvrant plusieurs parties du cerveau (Luo et al., 2019). On appelle la communication entre les neurones, au niveau des synapses, la plasticité synaptique[1]. Les neurones, les axiomes et les cellules gliales communiquent avec les autres neurones à leur point d’origine ou à leur point-cible (plasticité neuronale – Fig. 1). Un neurone peut entrer en réseau avec jusqu’à 10 000 autres neurones afin d’atteindre une capacité totale de 1000 Terabytes (Bartol et al. 2015). En plus de cela, les astrocytes et les cellules microgliales sont engagées dans des processus de réparation et agissent comme intermédiaires lors de l’échange d’informations entre les neurones. La plasticité neuronale et synaptique est bien documentée. Il n’est pas encore certain que le cerveau humain adulte soit capable de créer de nouveaux neurones (“neurogénèse” dans la zone subventriculaire, striatum et hippocampe).

Korbinian Brodmann fut un pionnier de la cartographie du cerveau humain. En 1909, il identifia 52 secteurs histologique dans le cerveau (les “Brodmann Areas” – BA), mais il ne pouvait étudier que des cerveaux malades. Les techniques en imagerie neurologique actuelles permettent aux chercheurs de regarder à l’intérieur d’un cerveau vivant et actif. Deux participants célèbres à des études d’imagerie furent Herbert von Karajan et Renée Fleming. Dès les années 1970, Karajan a permis à plusieurs reprises à des chercheurs de collecter des données pendant qu’il dirigeait (Müller, 2005). En 2017, Fleming fut fascinée de participer à une étude à l’aide d’Imagerie par Résonance Magnétique fonctionnelle, qui permit de découvrir ce qu’il se déroulait au sein du réseau cérébral pendant qu’une chanteuse professionelle chantait.

Suivant les paramètres de l’étude, les images et données collectées furent converties, retransmises et colorées pour obtenir des images à couper le souffle indiquant les régions concernées (regions of interest – ROI). L’éléctroencéphalographie (EEG) et la Magnétoencéphalographie (MEG) sont les techniques d’imagerie non intrusives les plus couramment utilisées pour étudier les régions de la matière grise montrant une activité pendant le chant. L’éléctroencéphalogramme dépeint uniquement les structures à la surface du cerveau et possède une résolution spatiale limitée. Cependant, il détecte les changements dans l’activité éléctrique en temps réel, presque à la milliseconde près. Le magnétoencéphalogramme, avec une résolutation similaire à l’EEG, est utilisé pour mesurer les champs magnétiques produits par l’activité cérébrale.

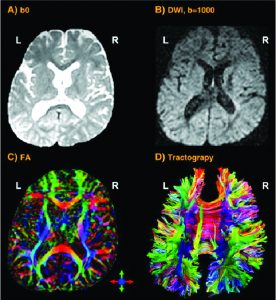

Si la recherche est portée sur l’épaisseur du cortex de la matière grise ou la taille ou les parties des fibres de matière blanche, des techniques d’imagerie offrant une résolution plus haute sont nécessaires. Imagerie par Résonance Magnétique (MRI – Fig. 2a) et IRM fonctionnelle (IRMf) sont fréquemment utilisées pour cette approche. Ces techniques visualisent les structures anatomiques du cerveau, même dans les régions sous-corticales. Cette méthode détecte les variations du taux d’oxygène dans le sang et les variations de tension induites par l’activité neuronale. Le signal BOLD (de Blood-Oygen-Level Dependent, dépendant du niveau d’oxygène sanguin) est une méthode spécifique d’IRMf qui utilise les différentes propriétés magnétiques de l’hémoglobine désoxygénée ou oxygénée afin de mesurer l’activité de la voix dans les régions du cerveau concernées.

Une stimulation augmentée entraîne les oligodendrocytes à former une gaine de myéline autour de l’axiome (la fibre nerveuse). Ainsi, le potentiel d’action se transforme, passant d’une propagation au long de l’axiome à une propagation saltatoire, sautant d’une zone dépourvue de myéline (nœud de Ranvier) à la suivante. Ceci accélère la transmission d’impulsions électriques. Un oligodendrocyte peut entourer de myéline plus de 50 neurones lors du processus d’apprentissage ou lorsqu’il répare des connexions abîmées. Les oligodendrocytes peuvent aussi retirer la myéline de certains axiomes pour éteindre une information et nettoyer les connexions. L’IRM de diffusion (Diffusion Tensor Imaging, DTI – Fig. 2b) détecte les fibres de manière magnifiquement détaillée. Tout comme l’IRM et l’IRMf, l’IRM de diffusion est non-intrusif et utilise le mouvement directionnel unique des molécules d’eau au long du système nerveux afin d’identifier les liens et structures des fibres de matière blanche avec une faible résolution temporelle.

D’autres techniques d’examen non-intrusives sont utilisées pour collecter des données prometteuses lors d’études portant sur la voix: la spectroscopie RMN (Résonance Magnétique Nucléaire) qui mesure les processus biochimiques dans un fort champ magnétique et les techniques d’imageries au microscope, à haute résolution et en 3D (Fig. 2c). Ils permettent de scanner un specimen avec une précision au nanomètre près, et au-delà. La tomographie par émission monophotonique, SPECT (de l’anglais: Single Photon Emission Computed Tomography) et la tomographie par émission de positons, TEP (Positron Emission Tomography) ou PET-Scan utilisent des traceurs (faiblement) radioactifs. Malgré leur faible résolution, ces deux méthodes dépeignent les processus fonctionnels efficacement en mesurant le flux sanguin. Les régions à forte radioactivité sont associées avec une forte activité cérébrale dans les régions sous-corticales.

Chaque méthode d’imagerie a ses avantages et ses inconvénients. Compiler les résultats de chaque approche dans les régions concernées améliore notre compréhension du processus nerveux lors du chant.

La principale caractéristique anatomique du cerveau humain est la structure en plis du cortex, composé de deux hémisphères reliés par un corps calleux. Les différentes techniques d’imageries vérifient cette latéralisation. Cela signifie que les deux hémisphères possèdent des régions impliquées dans le traitement de différentes tâches. Certaines taches sont orientées plutôt vers l’hémisphère gauche ou l’hémisphère droit, certaines peuvent concerner les deux hémisphères de manière équilibrée. L’hémishpère gauche est spécialisé dans des processus temporels rapides, l’hémisphère droit dans des processus temporels lents (Poeppel, 2003).

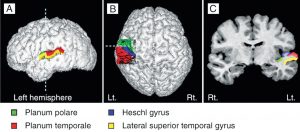

Les régions du chant et de la parole sont de célèbres exemples de latéralisation. Elles oscillent entre les régions cérébrales dédiées à la parole, situées à droite et à gauche, et peuvent aussi les partager. La production du langage et certains aspects du processus syntaxique sont localisés primairement dans des régions de l’hémisphère antérieur gauche, y compris dans l’aire de Broca (BA44/45). La compréhension du langage est primairement comprise dans la région temporale-pariétale antérieure gauche, y compris dans l’aire de Wernicke (BA22). Le planum temporal gauche (une circonvolution (ou gyrus) située dans le lobe temporal du cortex cérébral, NdT) peut être 10 fois plus grand, dans le cerveau humain, que le planum temporal droit (une région importante pour l’intonation faisant partie de BA22). L’aire de Broca est plus grande dans l’hémisphère droit. Le sulcus (frontière entre des noyaux cérébraux, NdT) central, qui abrite le cortex moteur primaire (aussi nommé M1 et qui commande l’appareil vocal) est aussi plus profond et plus grand dans l’hémisphère cérébral droit. (Corballi, 2014; Toga et al., 2003; Albouy et al., 2020).

Un résultat inattendu de la recherche réside en la découverte d’un cortex (ou ensemble de fibres blanches) plus épais chez des musiciens; cependant, cela ne permet pas de supposer un avantage général en soi entre musiciens et non-musiciens. Après une longue période de travail vocal, les régions du cerveau concernées sont utilisées de manière plus efficace, et la minutie des muscles nécessaires à l’émission du son chanté produit un feedback très fin. Ceci peut être mesuré dans certaines régions par une structure plus épaisse, mais ce n’est pas automatique. On suppose que dans ce processus plus efficace, un rôle particulier est joué par un réseau de synapses contenant une haute densité par neurone et une densité augmentée des cellules gliales (Gaser, Schlaug, 2003).

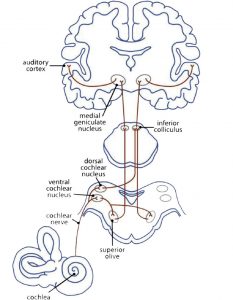

A première vue, la musique est connectée avec le sens de l’audition. La myélinisation des axiomes dans le cortex auditif commence déjà in utero, lors du troisième trimestre de la grossesse. Le réseau nerveux auditif (Fig. 3a) commence par le signal auditif qui parvient au tympan. La périlymphe (le fluide contenu dans l’oreille interne) transmet l’impulsion aux cellules ciliées internes et externes situées dans l’organe de Corti, qui sont prolongées par les stéréocils. Les stéréocils modifient ainsi leur position et donnent une impulsion à leurs cellules-racines, les cellules ciliées. Des transmetteurs chimiques se déversent dans l’espace intersynaptique afin d’ouvrir les canaux calciques (aussi appelés canaux Ca2+). Ceci apporte un signal électrique au conduit auditif : depuis la cochlée vers le complexe olivaire supérieur, vers le colliculus inférieur puis vers le noyau genouillé médian (dans le thalamus) jusqu’au cortex auditif primaire (A1) situé dans le gyrus temporal supérieur (STG). Ici, l’impulsion est transmise aux réseaux qui analysent l’information sonore (Cheung et al., 2017).

Le gyrus de Heschl (HG) correspond au cortex auditif (Fig 3b). Il est intimement impliqué dans la perception auditive, et sa morphologie, forme, taille et assymétrie influe également sur la performance musicale. Un gyrus de Heschl de droite plus grand indique une préférence pour une perception auditive effectuée de manière spectrale, lors de laquelle le son est fractionné en différents composants. Au contraire, une préférence donnée à la note fondamentale dans la perception du son provoque l’augmentation du volume du gyrus de Heschl de gauche (Brenner, Schneider et al., 2017). Concernant les instrumentistes, ceci est bien documenté. De plus amples recherches sont nécessaires pour examiner la différence entre la perception spectrale et la perception plus fondamentale du son dans le HG chez les chanteurs, et combien cela pourrait influencer le son d’un chœur.

La différence entre la structure du cerveau chez les chanteurs et chez les instrumentistes est significative. L’instrument des chanteurs, leur voix, fait partie de leur corps. Il croit et prend de l’âge continuellement, et il est utilisé en permanence pour la parole et le chant. Les chanteurs se fient non seulement à leur audition, mais aussi au feedback sensitivo-moteur qu’ils recoivent pendant le processus de production vocale. En conséquence d’un apprentissage du chant tout au long de la vie, on observe chez les chanteurs une matière grise plus importante dans la région de l’audition (par exemple dans les HG) et dans les régions moteures (par exemple dans l’aire motrice supplémentaire – SMA) ou dans le cervelet. Ainsi, la densité de la matière blanche dans les fibres commissurales ou dans les fibres d’association est plus élevée, et son volume dans l’hémisphère gauche est plus grand que chez les instrumentistes. (Loui, 2015; Schlaug et al., 2011).

Le cortex cérébral comprend les lobes frontal, temporal, pariétal et occipital avec leur 27 sulcus et leurs 16 gyrus, le cervelet et le tronc cérébral (Fig. 4). Le cortex cérébral contient aussi d’autres structures internes: le système limbique, les ganglions de la base et la substance blanche. Les fibres commissurales (corps calleux, fornix) assurent le transfert d’informations et la connexion entre les hémisphères. Les fibres d’association (arcuate fasciculus/longitudinal fasciculus/uncinate fasciculus) connectent les régions du cerveau au long et en profondeur au sein d’un seul hémisphère. Les fibres de projection sont la connexion avec la moelle épinière. Ces structures réagissent au chant, directement ou indirectement.

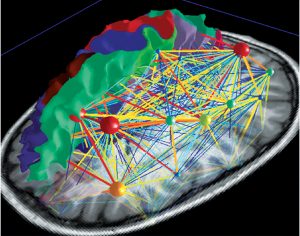

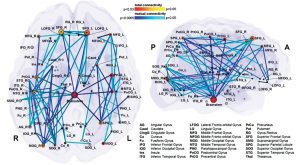

En contrôlant délibérément les mouvements dus à la production de la parole et du chant, on active un réseau très complexe et organisé de manière hiérarchique, qui peut être visualisé à l’aide d’une carte (Fig. 5a) Ainsi, on distingue des jonctions principales, qui elles-même connectent d’autres ramifications possédant différents niveaux d’importance. Ainsi, le réseau neuronal croît pour former une carte du cerveau personnelle et absolument unique (Fig. 5b). Obtenir une vision compréhensible de ce réseau complexe constitue un défi, mais il est passionnant d’analyser chaque secteur l’un après l’autre (atlas.brainnetome.org/bnatlas.html).

Le réseau central de l’activité chantée est le réseau du contrôle de la voix, qui est hiérarchiquement organisé. Le cortex cingulaire antérieur (CCA – un noeud important dans le traitement de la musique), les lobes inférieur, pariétal et occipital, certaines parties du système limbique et la substance grise périaqueducale (PAG) située autour de l’aqueduc du tronc cérébral (Fig. 6), sont des régions cruciales. Elles transmettent l’information vers les motoneurones phonatoires, qui sont chargés de donner le signal du départ du processus de phonation (Jürgens, 2009). Ces régions sont connectées au réseau généralement attribué à l’apprentissage de la phonation, constitué de la région M1, située dans le lobe frontal, et des régions responsables de l’ajustement minutieux du programme vocal lancé par le cortex moteur : le putamen et le globus pallidus, le pont et le cervelet. Le programme vocal, une fois au point, est renvoyé au M1 via le thalamus. En plus de cela, différentes régions du système nerveux du conduit auditif sont impliquées dans ce processus (comme indiqué plus haut). Lors de la comparaison des hauteurs de notes ou lors de l’exécution de mélodies, certaines régions à l’intérieur ou à l’extérieur du lobe temporal, dans le centre auditif ou le lobe frontal sont activées. Le timbre de la voix est réalisé dans le Sulcus Temporal Supérieur (STS) au coeur du lobe temporal. La reconnaissance de la voix s’effectue dans le STS antérieur (STSa). Le spectre vocal et la différenciation entre un son et un bruit s’effectue dans le STS antérieur médian, tandis que l’identification de voix inconnues se déroule dans le STS postérieur (STSp). Le circuit somatosensoriel avec le sulcus intrapariétal (IPS) et le cortex prémoteur dorsal traitent les stimuli sensoriels et les transforment en mouvement musculaire. Le feedback quant au mouvement et à la position (respiratoires et laryngés) est traité dans le cortex somatosensoriel primaire (S1) du lobe pariétal et du cortex insulaire. (Kleber, Zarate, 2014). ACC, STSp, IPS, AIC (Cortex Insulaire Antérieur) et cervelet interagissent pour contrôler le déroulement moteur complexe de la production vocale.

Cortex humain: Lobe frontal (bleu), cortex moteur primaire (rouge), lobe pariétal (vert), lobe occipital (jaune), lobe temporal (violet, cervelet (rose), tronc cérébral (brun).

Le Cortex Insulaire Antérieur (AIC) et le cervelet sont des noeuds importants pour la production vocale et doivent être observés plus en détail. L’AIC intègre des inputs des régions auditives, somatosensorielles, visuelles et moteures. Son rôle crucial dans le chant se déroule dans le larynx (via le cortex insulaire antérieur dorsal gauche) et le diaphragme (via le cortex insulaire antérieur dorsal bilatéral), en corrélation avec le thalamus (via le cortex insulaire postérieur dorsal bilatéral et gauche) et le putamen de gauche (via le cortex insulaire antérieur dorsal gauche) (Zamorano et al., 2019). Le cervelet participe particulièrement à la gestion temporelle et aux ajustements fins du contrôle moteur (larynx, muscles faciaux, équilibre, mouvements des yeux, précision de la coordination). Il est également actif dans les fonctions cognitives et émotionnelles (conducteur de sérotonine et de noradrénaline). L’apprentissage du chant provoque des changements structurels de densité de la matière grise dans les cortex somatosensoriels primaires et secondaires et dans le sulcus intrapariétal. Ceci joue un rôle essentiel dans le développement de la voix chantée.

En plus de l’activité dans la matière grise, des scientifiques ont découvert que les fibres de matière blanche (Fig. 7) jouent un rôle important en connectant les régions impliquées dans la production vocale. Les fibres nerveuses dorsales (Fig 7b) sont responsables de la transmission sensomoteure et sont décrites comme étant indirectement flexibles. Le cortex prémoteur (PMC), l’aire motrice supplémentaire (SMA) et la pré-SMA sont connectés entre eux via des “fibres en U” (et traitent la hauteur des sons comme la reconnaissance de rapports grammaticaux) et via le faisceau longitudinal supérieur (responsable de la perception des stimuli visuels et de l’articulation du langage). Ce faisceau en forme d’arc connecte les régions temporales et frontales du cerveau, le gyrus temporal supérieur (STG) avec le cortex prémoteur (PMC) et le gyrus frontal inférieur (IFG), reliant ainsi entre autres les régions BA44/45 et BA22 (Fig. 7c). Ils sont impliqués dans le traitement des informations auditives, dans la production vocale, dans le feedback du larynx (exactitude du chant) et dans l’activité pulmonaire en réponse à l’activité vocale.

Les fibres nerveuses ventrales (Fig. 7b) sont plutôt impliquées dans les processus directs et automatiques. Le faisceau longitudinal inférieur et la capsule extrême connectent le gyrus temporal moyen avec les régions BA44/45/47 et le gyrus frontal inférieur (IFG) et traitant les informations ayant trait aux mots, aux signes et à leur signification ainsi qu’à l’analyse de la hauteur des sons et des mélodies. Le faisceau unciné relie le cortex orbitofrontal (OF) au lobe temporal antérieur et traite les signaux vocaux, la mémoire, les émotions et les processus de décision. Le faisceau longitudinal inférier relie le lobe occipital et le lobe temporal afin d’identifier les objets vus (Bashwiner, 2018).

Le réseau du mode par défaut (MPD) et l’imagerie mentale sont deux réseaux importants impliqués dans le chant. Le MPD est active lors du repos éveillé ou lorsqu’on laisse vagabonder les pensées. Il est connecté à la créativité musicale, par exemple lors de l’improvisation, l’écriture ou la pratique musicale. L’imagerie mentale interagit également avec le MPD. Ceci désigne la surprenante capacité de se représenter concrètement de la musique, uniquement à force de concentration. Il combine entre autres les processus auditifs (par exemple les BA22 bilatéraux), la coordination sensori-motrice, le rappel de mémoire (cervelet), le contrôle cognitif (cortex préfrontal), les régions visuelles et les émotions (système limbique). Tout comme lors de la production vocale, l’imagerie mentale est une interaction entre les régions du cortex et de multiples réseaux, incluant les domaines de l’audition, de l’attention, et les réseaux decontrôles des mouvements. (Fig 8. – Zhang et al., 2017). Le MPD relie le cortex préfrontal dorsolatéral, le lobe temporal latéral et le planum polare (BA38), le cortex cingulaire postérieur, le précuneus et le gyrus angulaire ainsi que le lobe pariétal inférieur. En coopération avec les noeuds de l’activité moteur et de traitement du son (tels le cortex prémoteur dorsal, l’aire motrice supplémentaire et BA22) et les régions liées aux émotions (cortex orbitofrontal, BA38 et complexe amygdalien), le MPD forme un réseau extrêmement créatif.

En plus des réseaux anatomiques, des processus neuro-chimiques interagissent avec la production vocale. Le tronc cérébral, les ganglions de la base et le système limbique produisent des neurotransmetteurs et des hormones qui communiquent avec les neurones situés dans les régions choisies (striatum, noyaux accumbens, cortex cingulaire antérieur, cortex préfrontal). Ils inhibent ou provoquent l’activité via des circuits de stimulation glutamatergique, des circuits inhibiteurs gabaergiques et des circuits dopaminergiques. Le cervelet et le complexe amygdalien sont des stations importantes du circuit de la sérotonine et de la noradrénaline.

La dopamine et les opioïdes (tegmentum mésencéphalique, substantia nigra) jouent un rôle crucial dans les comportements liés au phénomène de récompense comme la motivation, le plaisir, le contrôle de l’attention, et ils renforcent le processus d’apprentissage. Le cortisol (hypophyse) et la sérotonine (noyaux du raphé) contrôlent le stress et l’excitation. Ils initient ou diminuent les facteurs de stress pour harmoniser les fonctions cognitives, les émotions et les fonctions corporelles subconscientes. La sérotonie renforce le système immunitaire, détend, a un effet anti-dépresseur et favorise la motivation. L’oxytocine (hypophyse) et les opioïdes endogènes tels que la dopamine et la vasopressine régulent l’immunité, les sensations de plaisir, d’appartenance sociale. Ainsi, chanter dans un chœur provoque certainement un effet social. Le rôle exact de l’oxytocine dans la pratique du chant n’est cependant pas encore exploré en détail. (Chanda, Levitin, 2013)

Afin de compléter le tableau, le champ de recherche de nos gènes doit être brièvement mentionné. Des scientifiques ont découvert des données prometteuses permettant d’établir un lien entre aptitudes musicales et chromosomes (Tan et al. 2014; Oikkonen et al. 2015). Les gènes contenus dans les chromosomes sont responsables de la production de protéines ou de récepteurs reliés aux neuro-transmetteurs. Grâce à eux, on a pu détecter le lien vers les régions du cerveau concernées. Voici quelques résultats: le gène GATA2, situé dans le chromosome 3q.21.3, régule le développement les cellules cilliées de la cochlée et du colliculus inférieur faisant partie du système auditif. De multiples gènes dans le chromosome 4 montrent une implication dans l’apprentissage des chants, dans la mémoire et dans la perception musicale. Ils sont aussi associés à l’exactitude du chant. Les gènes du chromosome 8 sont liés à l’apprentissage et à la mémoire, à l’oreille absolue et à la perception musicale. Le gène SLC6A4 du chromosome 17q11.2 est associé à la recherche de récompence, à la mémoire musicale et aux activités de groupe tel que chanter en chœur ou danser en groupe. Il est passionant d’observer la position des gènes liés au chant sur les chromosomes au moyen de cartes du génomes humain (par exemple sur genecards.org).

Bien plus de régions du cerveau sont impliquées et bilatéralement actives pendant le chant que l’on supposait jusqu’à peu. Il s’agit aussi bien de réseaux neuronaux multiples dans la matière grise et dans la matière blanche que de conduits chimiques et d’une prédisposition génétique. Tout comme des roues crantées dans une immense horloge, ces éléments créent notre symphonie des neurones, personnelle et unique. La neuroscience montre la beauté du cerveau humain et ses incroyables capacités. Les résultats de ce passionnant domaine de recherche pourraient aider au traitement de troubles de fonctionnement de l’appareil vocal. Des études prometteuses explorent la récupération de la voix au moyen d’un appareil vocal artificiel construit à l’aide d’une imprimante 3D en utilisant des données d’imagerie individuelles. Ceci est l’encourageant début de prochaines recherches (Howard, 2020).

Cependant, il reste encore beaucoup à découvrir sur le processus du chant. En effet, plus nous obtenons des réponses, plus se posent à nous de nouvelles questions, tandis que notre fascination pour le cerveau humain et la magie de la musique ne cesse de croître.

Références: Texte

- Albouy P., Benjamin L., Morillon, Zatorre R.J., 2020. Distinct sensitivity to spectrotemporal modulation supports brain asymmetry for speech and melody. McGill University, Montreal, Canada. doi:10.1126/science.aaz3468

- Alexander A.L., Lee J.E., Lazar M., Field A.S., 2007. Diffusion Tensor Imaging of the Brain. University of Wisconsin-Madison; New York University School of Medicine, New York USA., doi:10.1016/j.nurt.2007.05.011

- Altenmüller E., Furuya S., 2017. Apollos Gift and Curse: Making Music as a model for Adaptive and Maladaptive Plasticity. Hochschule für Musik, Theater und Medien Hannover, Germany. doi:10.1515/nf-2016-A054

- Bartol Jr. T.M., Bromer C., Kinney J., Chirillo M.A., Bourne J. N., Harris K. M., Sejnowski T.J., 2015. Nanoconnectomic upper bound on the variability of synaptic plasticity. Salk Institute for Biological Studies, La Jolla, United States. doi:10.7554/eLife.10778.001

- Bashwiner D., Bacon D., 2018. Musical creativity and the motor system. University of New Mexico, Albuquerque, United States. doi:10.1016/j.cobeha.2018.12.005

- Bashwiner D.M., Wertz C.J., Flores R.A., Jung R.E., 2015. Musical Creativity “Revealed” in Brain Structure: Interplay between Motor, Default Mode, and Limbic Networks. University of New Mexico, Albuquerque, United States. doi:10.1038/srep20482

- Benner J., Wengenroth M., Reinhardt J., Stippich C., Schneider P., Blatow M., 2017. Prevalence and function of Heschl’s gyrus morphotypes in musicians. University of Heidelberg Medical School, Germany. doi:10.1007/s00429-017-1419-x

- Butler B.E., Stephen G. Lomber S.G., 2013. Functional and structural changes throughout the auditory system following congenital and early-onset deafness: implications for hearing restoration. University of Western Ontario, Canada. doi:10.3389/fnsys.2013.00092

- Chanda M.L., Levitin D.J., 2013. The neurochemistry of music. McGill University, Montral, Canada. doi:10.1016/j.tics.2013.02.007

- Cheung V.K.M., Meyer L., Friederici A.D., Koelsch S., 2017. The right inferior frontal gyrus processes nested non-local dependencies in music. Max Planck Institut Leipzig, Germany; University of Bergen, Norway. doi:10.1038/s41598-018-22144-9

- Christiner M., Reiterer S.M., 2015. A Mozart is not a Pavarotti: Singers outperform instrumentalists on foreign accent imitation. University of Vienna, Austria. doi:10.3389/fnhum.2015.00482

- Cohen A.J., Levitin D., Kleber B.A., 2020. Brain mechanisms underlying singing. doi:10.4324/9781315163734-6

- Cole M.W., Reynolds J.R., Power J.D., Repovs G., Anticevic A., Braver T.S., 2013. Multi-task connectivity reveals flexible hubs for adaptive task control. Washington University in St. Louis, United States. doi:10.1038/nn.3470

- Corballis M.C., 2014. Left Brain, Right Brain: Facts and Fantasies. School of Psychology, University of Auckland, New Zealand. doi:10.1371/journal.pbio.1001767

- Englander Z.A., Pizoli C.E., Batrachenko A., Sun J., Worley G., Mikati M.A., Kurtzberg J., Song A.W., 2013. Diffuse reduction of white matter connectivity in cerebral palsy with specific vulnerability of long range fiber tracts. Duke University Medical Center, United States. doi:10.1016/j.nicl.2013.03.006

- Gaser C., Schlaug G., 2003. Brain structures differ between musicians and non-musicians. University Jena, Germany, Harvard Medical School, Boston United States. doi:10.1523/JNEUROSCI.23-27-09240.2003

- Goschke T., 2013. Methoden der Kognitiven Neurowissenschaft: Kurze Einführung in die funktionelle Bildgebung, ModulA1 SS 2013. TU Dresden

- Halwani G.F., Loui P., Rüber T., Schlaug G., 2011. Effects of practice and experience on the arcuate fasciculus: comparing singers, instrumentalists, and non-musicians. Harvard Medical School, Boston, United States. doi:10.3389/fpsyg.2011.00156

- Hill V.B., Cankurtaran C.Z., Liu B.P., Hijaz T.A., Naidich M., Nemeth A.J., Gastala J., Krumpelman C., McComb E.N., Korutz A.W., 2019. A Practical Review of Functional MRI Anatomy of the Language and Motor Systems. Northwestern University Feinberg School of Medicine, Chicago, United States. doi:10.3174/ajnr.A6089

- Howard D.M., 2020. Synthesis of a Vocal Sound from the 3,000 year old Mummy, Nesyamun ‘True of Voice’. Royal Holloway, University of London, United Kingdom. doi:10.1038/s41598-019-56316-y

- Jürgens U., 2009.The Neural Control of Vocalization in Mammals: A Review. German Primate Center Göttingen, Germany. doi:10.1016/j.jvoice.2007.07.005

- Kaufmann C., Auer D.P., 2002. Brain imaging in psychiatry. Psychotherapie 7. Jahrg. 2002, Bd. 7, Heft 2. CIP-Medien, München

- Kleber B., Friberge A., Zeitounic A., Zatorre R., 2016. Experience-dependent modulation of right anterior insula and sensorimotor regions as a function of noise-masked auditory feedback in singers and nonsingers. Canada, Germany, Sweden, Denmark. doi:10.1016/j.neuroimage.2016.11.059.

- Kleber B., Veit R., Birbaumer N., Gruzelier J., Lotze M., 2009. The Brain of Opera Singers: Experience- Dependent Changes in Functional Activation. Germany, Italy, United Kingdom. doi:10.1093/cercor/bhp177

- Kleber B.A., Zarate J.M., 2014. The neuroscience of singing. Oxford University Press, Oxford, United Kingdom. doi:10.1093/oxfordhb/9780199660773.013.015

- Koelsch S., 2012. Brain and Music. John Wiley & Sons Ltd., Chichester, United Kingdom. ISBN: 978-0-470-68339-2

- Kolb, B., Muhammad, A., Gibb, R., 2010. Searching for factors underlying cerebral plasticity in the normal and injured brain, Journal of Communication Disorders. University of Lethbridge, Canada. doi:10.1016/j.jcomdis.2011.04.007

- Loui P., 2015. A dual-stream neuroanatomy of singing. Wesleyan University, Universitiy of California Press, United States. doi:10.1525/MP.2015.32.3.232

- Luo N., Sui J., Abro A., Turner J.A., Damara E., Fu Z., Fan L., Chen J., Lin D., Zhuo C., Xu Y., Glahn D.C., Rodrigue A.L., Banich M.T., Pearlson G.D., Calhoun V.C., 2019. Structural brain architectures match intrinsic functional networks and vary across domains: A study from 15000+ individuals. China, United States. doi:10.1101/2019.12.17.879502

- Martínez-Molina N., Mas-Herrero E., Rodríguez-Fornells A., Robert J. Zatorre R.J., Marco-Pallerés J., 2019. White matter microstructure reflects individual differences in music reward sensitivity. Universitiy of Barcelona, Spain; McGill University, Canada. doi:10.1523/JNEUROSCI.2020-18.2019

- Oikkonen J., Huang Y., Onkamo P., Ukkola-Vuoti L., Raijas P., Karma K., Vieland V.J., Järvelä I., 2015. A genome-wide linkage and association study of musical aptitude identifies loci containing genes related to inner ear development and neurocognitive functions. Univerity of Helsinki, Finland. doi:10.1038/mp.2014.8

- Oxenham A.J., 2018. How we hear: The perception and neural coding of sound. University of Minnesota, United States. doi:10.1146/annurev-psych-122216-011635

- Patel A.D., 2007. Music, language and the brain. Oxford University Press NewYork, United States. doi:10.1093/acprof:oso/9780195123753.001.0001

- Poeppel D., 2003.The analysis of speech in different temporal integration windows: Cerebral lateralization as ‘asymmetric sampling in time’. New York University, United States. doi:10.1016/S0167-6393(02)00107-3

- Segado M., Hollinger A., Thibodeau J., Penhune V., Zatorre R.J., 2018 Partially Overlapping Brain Networks for Singing and Cello Playing. Concordia University Montreal, Canada. doi:10.3389/fnins.2018.00351

- Simonyan K., Barry Horwitz B., 2011. Laryngeal Motor Cortex and Control of Speech in Humans. Mount Sinai School of Medicine New York, United States. Neuroscientist 2011. April; 17(2): 197–208. doi:10.1177/1073858410386727

- Steel C.J., Zatorre R.J., 2018. Practice makes plasticity. Max Planck Institute, Leipzig Germany; McGill University, Montreal, Canada. doi:10.1038/s41593-018-0280-4

- Takahashi T., Suzuki M., Kurachi M., 2010. A follow-up MRI study of the superior temporal subregions in schizotypal disorder and first-episode schizophrenia. Schizophrenia Research. Volume 119, Issues 1–3, June 2010, Pages 65-74. Corpus ID: 26117184. doi:10.1016/j.schres.2009.12.006

- Tan Y.T., McPherson G.E., Peretz I., Berkovic S.F., Wilson S.J., 2014. The genetic basis of music ability. University of Melburne, Australia. doi:10.3389/fpsyg.2014.00658

- Toga A.W., Thompson P.M., 2003. Mapping brain asymmetry. UCLA School of Medicine, Los Angeles, United States. doi:10.1038/nrn1009

- Wang W., Wie L., Chen N., Jones J.A., Gong G., Liu H., 2019 Decreased Gray-Matter Volume in Insular Cortex as a Correlate of Singers’ Enhanced Sensorimotor Control of Vocal Production. University Guangzhou; Beijing Normal University, China; Wilfrid Laurier University, Canada. doi:10.3389/fnins.2019.00815

- Zamorano A.M., Zatorre R.J., Vuust P., Friberg A., Birbaumer N., Kleber B., 2019. Enhanced insular connectivity with speech sensorimotor regions in trained singers – a resting-state fMRI study. Germany, Switzerland, Denmark, Spain, Canada, Sweden. doi:10.1101/793083

- Zhang Y., Chen G., Wen H., Lu K., Liu Z., 2017. Musical Imagery Involves Wernicke’s Area in Bilateral and Anti-Correlated Network Interactions in Musicians. Purdue University, West Lafayette, United States. doi:10.1038/s41598-017-17178-4

Plus de 25 ans d’expérience en tant que chef de chœur et coach vocal pour chanteurs de tous âges; créatrice d’une école de musique et d’un chœur indépendants. Son expérience inspire à l’ouverture et à de nouveaux chemins musicaux. Organisatrice de rencontres chorales internationales pour explorer d’autres cultures et le monde choral; fascinée par les arts en général et les sciences en particulier.

- Participation à des master class internationales de direction.

- Présentation lors de la Community Music Conference à Munich en 2015: “Création d’un chœur d’enfants de concert basé sur la philosophie de la Community Music – opposition ou confirmation – un rapport d’expérience”.

- Participation à chaque Symposium Mondial pour la Musique Chorale depuis 1999

- Participation à des concours internationaux de chant choral, plusieurs distinctions.

- Diplômée en pédagogie vocale, Fulda/Allemagne

- Diplômée en direction de chœur et direction de chœur d’enfants, Wolfenbüttel/Allemagne.

Contact: ertl@icloud.com

Traduit de l’allemand et de l’anglais par Isabelle Métrope, Allemagne

[1] La communication entre les neurones au niveau des synapses est appelée plasticité synaptique. On en distingue deux types: la “plasticité fonctionnelle”, qui renforce ou affaiblit les connections synaptiques existantes à travers une potentialisation à long terme (LTP) ou une dépression synaptique à long terme (LTD) et la “plasticité structurelle” qui désigne une modification de la morphologie et de l’organisation des synapses existantes, donc la formation ou l’élimination de synapses.